COME FAR GIRARE MODELLI LINGUISTICI DA UNA CHIAVETTA USB SENZA INSTALLAZIONE

INDICE DEI PARAGRAFI

Introduzione

Perché l’IA locale sta cambiando il lavoro sanitario

Che cos’è un modello linguistico locale

Il ruolo di llamafile nella pratica clinica

Che cos’è il formato GGUF

Configurazione ideale per studi medici e nutrizionali

Modelli consigliati per computer con 16 GB di RAM senza VRAM

Perché i modelli MoE possono essere più efficienti

Esempi pratici per il biologo nutrizionista

Esempi pratici per il medico

Privacy, GDPR e protezione dei dati sanitari

Guida pratica alla configurazione

Limiti attuali dell’IA locale

Prospettive future dell’IA sanitaria offline

Conclusione

Glossario

Riferimenti bibliografici

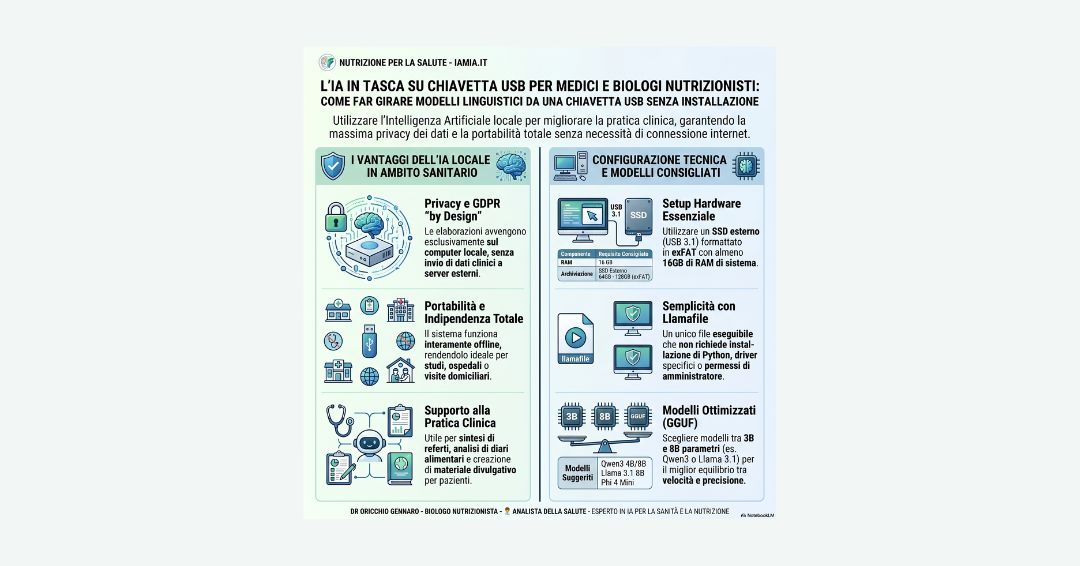

INTRODUZIONE

L’intelligenza artificiale sta rapidamente entrando nella pratica quotidiana di medici e biologi nutrizionisti. Sempre più professionisti utilizzano sistemi di IA per organizzare informazioni cliniche, sintetizzare documenti, produrre contenuti divulgativi, analizzare letteratura scientifica o migliorare la gestione operativa dello studio.

La maggior parte di questi strumenti funziona online attraverso piattaforme cloud. Questo approccio offre elevate capacità computazionali, ma introduce anche problematiche legate alla privacy dei dati sanitari, alla dipendenza dalla connessione internet e alla gestione di informazioni sensibili.

Negli ultimi anni si è sviluppata una soluzione alternativa particolarmente interessante: l’IA locale portatile. Grazie a strumenti come llamafile e ai modelli GGUF, oggi è possibile utilizzare modelli linguistici avanzati direttamente da una chiavetta USB, senza installazione complessa e senza necessità di connessione internet.

Per il professionista sanitario questo significa poter avere un assistente intelligente personale, privato e sempre disponibile, direttamente nel proprio taschino.

PERCHÉ L’IA LOCALE STA CAMBIANDO IL LAVORO SANITARIO

Nel settore sanitario la gestione delle informazioni rappresenta una delle attività più impegnative.

Medici e biologi nutrizionisti lavorano quotidianamente con:

Anamnesi.

Esami ematochimici.

Referti.

Linee guida.

Diari alimentari.

Documentazione clinica.

Materiale divulgativo.

L’intelligenza artificiale locale permette di utilizzare strumenti avanzati mantenendo il controllo diretto dei dati.

Questo approccio offre vantaggi molto concreti:

Nessun invio di dati clinici verso server esterni.

Possibilità di lavorare anche offline.

Riduzione della dipendenza da piattaforme cloud.

Maggiore controllo sulla privacy.

Portabilità completa del sistema.

CHE COS’È UN MODELLO LINGUISTICO LOCALE

Un modello linguistico locale è un sistema di intelligenza artificiale che gira direttamente sul computer dell’utente senza richiedere elaborazione remota online.

In pratica il computer utilizza:

CPU.

RAM.

Eventuale GPU.

Per generare le risposte.

Questo significa che il modello continua a funzionare anche senza internet e che tutte le elaborazioni avvengono localmente.

Per il professionista sanitario questo approccio può essere utile per:

Creazione di testi.

Riassunti clinici.

Produzione di materiale divulgativo.

Supporto organizzativo.

Analisi preliminare documentale.

Generazione di template.

IL RUOLO DI LLAMAFILE NELLA PRATICA CLINICA

Llamafile rappresenta una delle innovazioni più interessanti nel panorama dell’IA locale.

Il progetto permette di distribuire modelli linguistici in un singolo file eseguibile basato sull’ecosistema llama.cpp.

Questo approccio elimina gran parte della complessità tecnica normalmente associata ai modelli locali.

Non servono:

Installazioni Python.

Configurazioni avanzate.

Driver specifici.

Permessi amministratore.

Per medici e biologi nutrizionisti significa poter creare una vera postazione IA portatile utilizzabile:

In studio.

In ambulatorio.

Durante congressi.

Su computer differenti.

Durante visite domiciliari.

CHE COS’È IL FORMATO GGUF

Il formato GGUF è stato sviluppato per ottimizzare l’esecuzione dei modelli linguistici su hardware consumer.

La caratteristica più importante è la quantizzazione, cioè una compressione intelligente che riduce il peso del modello e il consumo di memoria senza compromettere eccessivamente la qualità delle risposte.

Le versioni più utilizzate sono:

Q4.

Q4_K_M.

Q5_K_M.

Q6.

Per computer con 16 GB di RAM senza scheda video dedicata, il miglior equilibrio tra qualità e prestazioni è generalmente rappresentato da Q4_K_M.

CONFIGURAZIONE IDEALE PER STUDI MEDICI E NUTRIZIONALI

Una configurazione efficace può essere relativamente semplice.

Hardware consigliato:

Notebook o mini PC con 16 GB RAM.

SSD interno.

CPU moderna Intel o AMD.

SSD esterno USB 3.1 oppure USB-C.

Windows 11.

Per l’archiviazione è consigliabile utilizzare un SSD esterno piuttosto che una comune chiavetta USB, perché offre maggiore velocità e stabilità.

La capacità consigliata è almeno 64 GB, preferibilmente 128 GB.

Il file system deve essere exFAT perché FAT32 non consente file superiori a 4 GB, mentre molti modelli GGUF superano facilmente questa dimensione.

MODELLI CONSIGLIATI PER COMPUTER CON 16 GB DI RAM SENZA VRAM

Per un computer con 16 GB di RAM e senza scheda video dedicata è prudente scegliere modelli GGUF quantizzati in Q4 o Q5, preferibilmente tra 3B e 8B parametri.

I modelli più grandi possono avviarsi, ma diventano lenti e meno stabili quando sistema operativo, browser e modello saturano la memoria disponibile.

Modelli consigliati:

Qwen3 4B GGUF Q4_K_M o Q5_K_M

Ideale per scrittura, sintesi, chat cliniche e organizzazione documentale.

Qwen3 8B GGUF Q4_K_M

Adatto a testi più complessi, RAG leggero e ragionamento generale.

Llama 3.1 8B Instruct GGUF Q4_K_M

Ottima qualità generale e buona gestione della lingua italiana.

Gemma 3 4B GGUF Q4_K_M

Rapido e leggero per utilizzo quotidiano.

Mistral 7B Instruct GGUF Q4_K_M

Ancora molto valido per scrittura tecnica e riassunti.

Phi 4 Mini GGUF

Interessante per velocità e basso consumo di RAM.

Qwen3 14B GGUF

Possibile su 16 GB RAM ma vicino al limite operativo.

Qwen3 30B A3B GGUF

Interessante come test tecnico, ma non ideale come soluzione quotidiana senza GPU.

PERCHÉ I MODELLI MOE POSSONO ESSERE PIÙ EFFICIENTI

I modelli MoE, cioè Mixture of Experts, rappresentano una delle evoluzioni più interessanti delle architetture IA.

Un modello tradizionale utilizza tutti i parametri contemporaneamente. Un modello MoE attiva soltanto alcuni “esperti” in base alla richiesta ricevuta.

Questo può migliorare:

Velocità.

Efficienza computazionale.

Qualità delle risposte.

Riduzione del carico operativo.

Il modello Qwen3 30B A3B è particolarmente interessante perché possiede circa 30,5 miliardi di parametri totali ma attiva solo una parte del sistema durante l’inferenza.

Nonostante questo vantaggio, tutti i pesi devono comunque essere caricati o gestiti in memoria, quindi su computer con 16 GB RAM resta un modello sperimentale più che una soluzione stabile per uso clinico quotidiano.

ESEMPI PRATICI PER IL BIOLOGO NUTRIZIONISTA

L’IA locale può diventare un supporto operativo molto utile nella pratica nutrizionale.

Produzione di contenuti divulgativi

Il professionista può utilizzare il modello per:

Scrivere articoli.

Creare contenuti social.

Preparare podcast.

Riassumere studi scientifici.

Supporto alla pratica clinica

Possibili applicazioni:

Sintesi di diario alimentare.

Creazione di template anamnestici.

Preparazione di schemi educativi.

Produzione di spiegazioni semplificate per il paziente.

RAG nutrizionale locale

Il modello può essere collegato a linee guida PDF locali per creare sistemi di ricerca offline dedicati esclusivamente alla nutrizione clinica.

ESEMPI PRATICI PER IL MEDICO

Anche il medico può utilizzare modelli locali come assistenti organizzativi.

Sintesi documentale

Riassunto di referti.

Organizzazione dati clinici.

Creazione di lettere standard.

Preparazione di informative.

Supporto congressuale

Riassunti scientifici.

Preparazione slide.

Traduzione di articoli.

Produzione di schemi divulgativi.

Supporto amministrativo

Generazione di documentazione organizzativa.

Creazione di template standardizzati.

Produzione di materiale GDPR.

È fondamentale ricordare che il modello linguistico non sostituisce il giudizio clinico del professionista.

PRIVACY, GDPR E PROTEZIONE DEI DATI SANITARI

Uno degli aspetti più importanti dell’IA locale riguarda la protezione dei dati.

Quando il modello gira interamente sul computer:

I documenti restano nel dispositivo.

Le conversazioni non vengono inviate online.

Il sistema continua a funzionare offline.

Questo approccio può rappresentare un vantaggio importante in ambito sanitario, dove la protezione delle informazioni cliniche è centrale.

GUIDA PRATICA ALLA CONFIGURAZIONE

Preparazione del supporto

Utilizzare una chiavetta USB 3.0 o un SSD esterno formattato exFAT.

Download di llamafile

Scaricare il file eseguibile e copiarlo nella memoria USB.

Download del modello GGUF

Scaricare il modello desiderato da Hugging Face.

Creazione del file batch

Esempio semplice:

llamafile.exe -m qwen3-4b-q4_k_m.gguf

pause

Esempio con contesto controllato:

llamafile.exe -m qwen3-8b-q4_k_m.gguf -c 4096

pause

Avvio

Con doppio clic il sistema caricherà il modello e aprirà automaticamente l’interfaccia nel browser.

LIMITI ATTUALI DELL’IA LOCALE

Nonostante i grandi progressi recenti, esistono ancora alcuni limiti:

Velocità inferiore rispetto ai sistemi cloud professionali.

Possibili errori interpretativi.

Consumo elevato di RAM con modelli grandi.

Prestazioni limitate senza GPU.

Necessità di supervisione professionale continua.

Per questo motivo l’IA locale deve essere considerata uno strumento di supporto operativo e non un sistema autonomo di decisione clinica.

PROSPETTIVE FUTURE DELL’IA SANITARIA OFFLINE

L’evoluzione dei modelli open source e delle tecniche di quantizzazione potrebbe cambiare profondamente la pratica sanitaria.

È probabile che nei prossimi anni diventino comuni:

Assistenti clinici locali.

RAG sanitari offline.

IA integrate nelle cartelle cliniche.

Supporti decisionali locali.

Sistemi nutrizionali personalizzati offline.

Questo scenario potrebbe favorire una maggiore sovranità digitale sanitaria mantenendo il controllo locale dei dati clinici.

CONCLUSIONE

L’intelligenza artificiale locale rappresenta una delle innovazioni più interessanti per medici e biologi nutrizionisti. La possibilità di utilizzare modelli linguistici direttamente da una chiavetta USB, senza installazione e senza internet, apre nuovi scenari operativi nella pratica professionale quotidiana.

Grazie a llamafile, ai modelli GGUF e alle moderne tecniche di quantizzazione, oggi è possibile costruire assistenti IA portatili anche su computer standard con 16 GB di RAM e senza GPU dedicata.

La vera rivoluzione non riguarda soltanto la tecnologia, ma il controllo dei dati, la portabilità e la possibilità di avere un sistema intelligente sempre disponibile direttamente nel proprio studio professionale.

Disclaimer:

I contenuti sono generati con l’ausilio di ChatGPT e verificati con Gemini, sulla base di idee nate dal mio lavoro di biologo nutrizionista ed esperto in IA per la sanità e la nutrizione. Ogni testo è esaminato, adattato e validato secondo le mie competenze professionali. Le informazioni hanno scopo divulgativo e non sostituiscono la consulenza di un professionista sanitario qualificato.

GLOSSARIO

LLM

Large Language Model, modello linguistico di grandi dimensioni.

GGUF

Formato ottimizzato per eseguire modelli IA in locale.

Quantizzazione

Tecnica che riduce dimensioni e consumo di memoria del modello.

VRAM

Memoria dedicata della scheda video.

Inferenza

Processo attraverso cui il modello genera risposte.

RAG

Retrieval Augmented Generation, sistema che combina ricerca documentale e IA.

MoE

Mixture of Experts, architettura che attiva solo alcune parti del modello.

RIFERIMENTI BIBLIOGRAFICI